IEC/ISO TR 5469 电气/电子产品安全和人工智能

具备法律效应

国际认可资质

当天申报

进度实时可查

1v1全程陪审

优质服务体验

随着人工智能技术在工业领域的深度渗透,其功能安全风险成为全球标准化关注的焦点。2024年1月,国际标准化组织(ISO)与国际电工委员会(IEC)联合发布技术报告IEC/ISO TR 5469:2024,为安全关键系统中AI技术的应用构建了首个国际性指导框架。该标准由ISO/IEC联合技术委员会SC 42(人工智能委员会)牵头制定,中国、美国、德国等25国专家参与,中国团队在AI安全架构设计领域贡献了关键方案。

一、标准核心定位与适用范围

该技术报告聚焦AI系统在涉及生命安全或重大财产损失场景中的应用,明确三大适用场景:

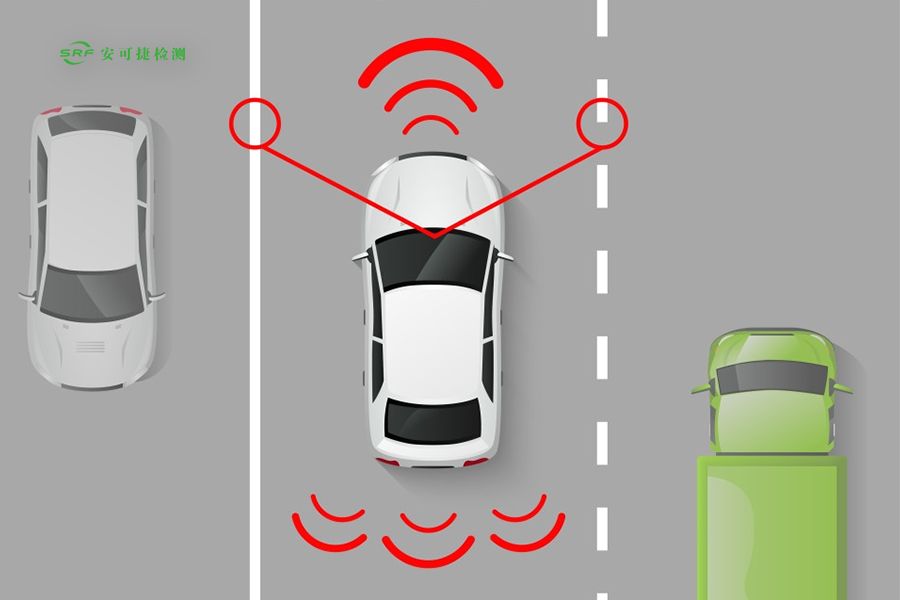

AI直接实现安全功能:如自动驾驶汽车的障碍物识别系统;

非AI安全功能保障AI设备安全:如通过传统冗余设计监控AI决策;

AI辅助设计安全功能:如利用AI优化安全关键系统的参数配置。

标准将AI技术按功能安全参与度分为四类:

A类:AI作为核心安全机制(如医疗设备的AI诊断模块);

B类:AI用于安全开发工具(如离线仿真测试);

C类:AI对安全有间接影响(如预测性维护);

D类:AI与安全无关(需排除在安全分析外)。

二、全生命周期安全管理体系

标准提出覆盖AI系统全生命周期的三阶段实现原则,并与传统功能安全标准深度融合:

数据采集阶段:

制定数据质量指标(如多样性、标注一致性),避免“垃圾进,垃圾出”;

采用PFMEA(过程失效模式与影响分析)识别数据污染风险。

模型训练阶段:

引入“安全笼子”概念,要求AI输出必须通过非AI监控组件验证;

提出模型简化技术(如知识蒸馏)以提升可解释性。

模型部署阶段:

规定冗余设计准则,如双AI系统需满足“开发团队独立、训练数据隔离、硬件平台差异”等多样性要求;

建立运行监控指标(如输出置信度阈值、域偏移检测)。

三、关键技术要求与创新点

安全架构设计:

冗余备份:非AI组件作为AI决策的“安全网”,在AI输出异常时接管控制;

动态约束:通过安全边界(Safe Envelope)限制AI操作范围,如自动驾驶中禁止AI在暴雨天气执行变道。

验证与确认挑战:

针对AI“黑箱”特性,提出“过程证据链”方法,通过记录数据采集、模型训练、测试覆盖等环节的KPI(如对抗样本防御率)间接证明安全性;

开发AI特定测试场景,如医疗AI需验证其对罕见病例的泛化能力。

与传统标准兼容性:

附录A将IEC 61508(工业功能安全)的软件要求与AI技术要素映射,明确机器学习模型需满足“模块化设计”“变更影响分析”等传统安全要求。

四、行业影响与实施路径

对汽车行业:自动驾驶系统需同时满足ISO/PAS 8800(道路车辆AI安全)与IEC/ISO TR 5469,例如特斯拉FSD需通过冗余AI通道的共因失效分析。

对医疗设备:AI诊断算法需符合IEC 62304(医疗软件生命周期),同时按本标准实施模型验证,如CT影像AI需证明其对新型病毒模式的识别鲁棒性。

对工业控制:制造业AI需结合IEC 61508,例如化工装置的AI优化控制器需通过“安全完整性等级(SIL)”认证。

五、挑战与未来方向

尽管标准提供了框架性指导,但实施仍面临两大挑战:

技术成熟度:AI可解释性工具(如LIME、SHAP)的工程化应用仍需深化;

监管协同:需建立AI安全认证与现有产品准入制度的衔接机制,如欧盟CE认证与本标准的互认流程。

IEC/ISO TR 5469:2024的发布标志着AI功能安全进入标准化时代。随着AI 2.0技术的演进,该标准有望迭代升级,为智能机器人、航空航天等前沿领域构建更严密的安全防线。